在自然语言处理中,有很多信息其实是重复的。

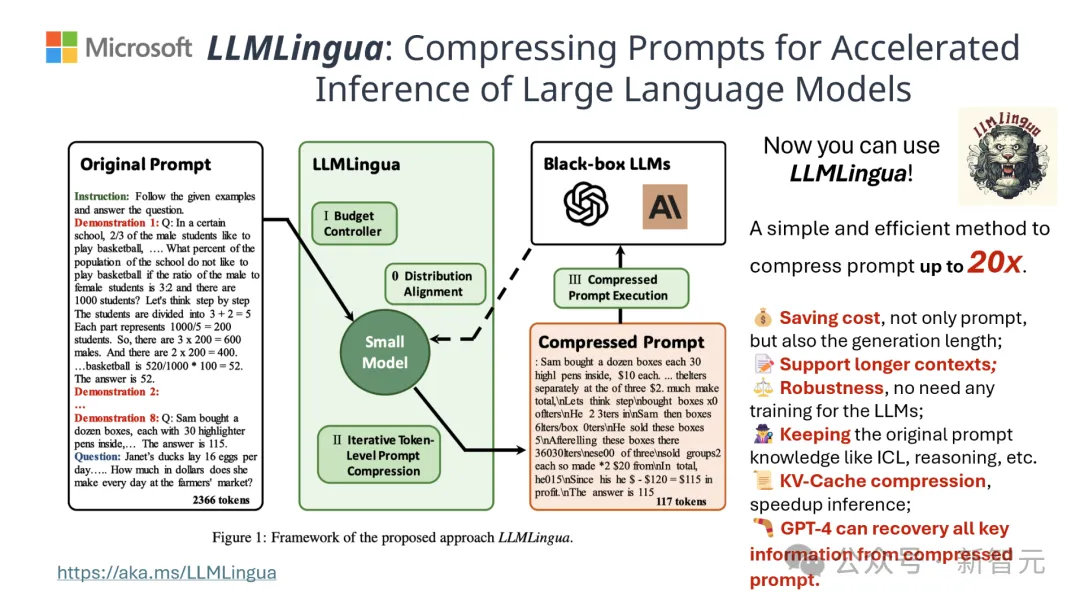

如果能将提示词进行有效地压缩,某种程度上也相当于扩大了模型支持上下文的长度。

现有的信息熵方法是通过删除某些词或短语来减少这种冗余。

然而,基于信息熵的计算仅涵盖了文本的单向上下文,可能会忽略压缩所需的关键信息;而且,信息熵的计算方式并非完全符合压缩提示词的实际目的。

为了迎接这些挑战,清华大学和微软的研究人员共同提出了一项全新的数据处理流程,名为LLMLingua-2。其旨在从大型语言模型(LLM)中提取知识,通过压缩提示词实现信息的精炼,同时确保关键信息不会丢失。

☞☞☞AI 智能聊天, 问答助手, AI 智能搜索, 免费无限量使用 DeepSeek R1 模型☜☜☜

项目在GitHub上已经斩获3.1k星

结果显示,LLMLingua-2可以将文本长度大幅缩减至最初的20%,有效减少了处理时间和成本。

此外,与前一版本LLMLingua以及其他类似技术相比,LLMLingua 2的处理速度提高了3到6倍。

论文地址:https://arxiv.org/abs/2403.12968

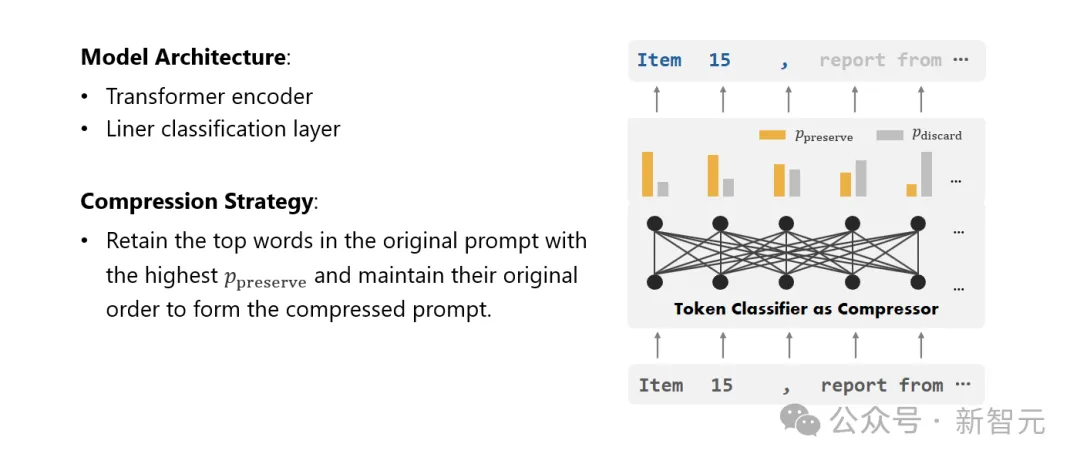

在这个过程中,原始文本首先被输入模型。

模型会评估每个词的重要性,决定是保留还是删除,同时也会考虑到词语之间的关系。

最终,模型会选择那些评分最高的词汇组成一个更简短的提示词。

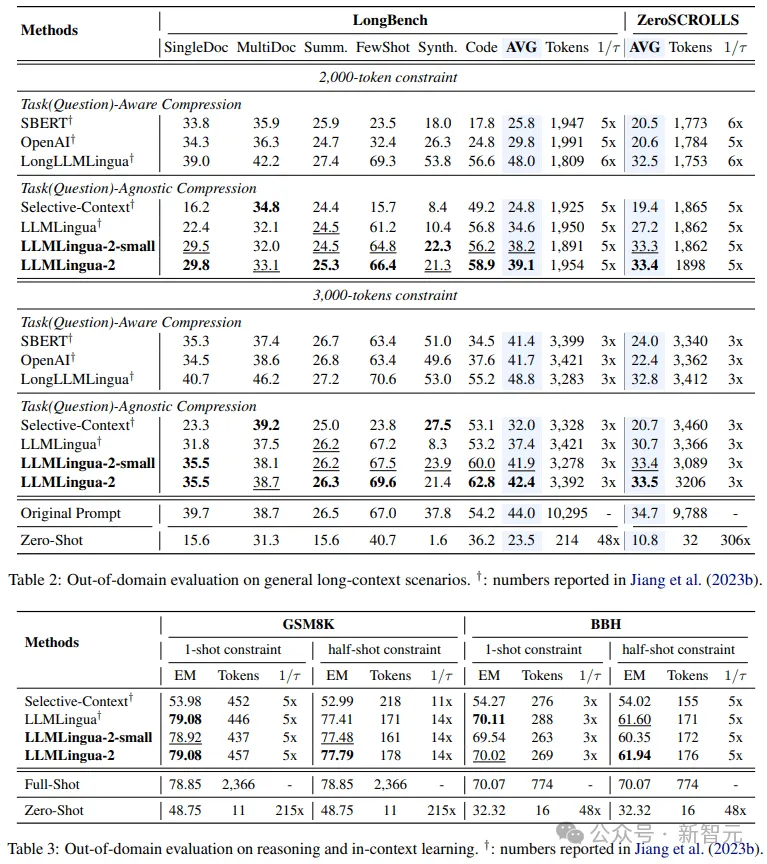

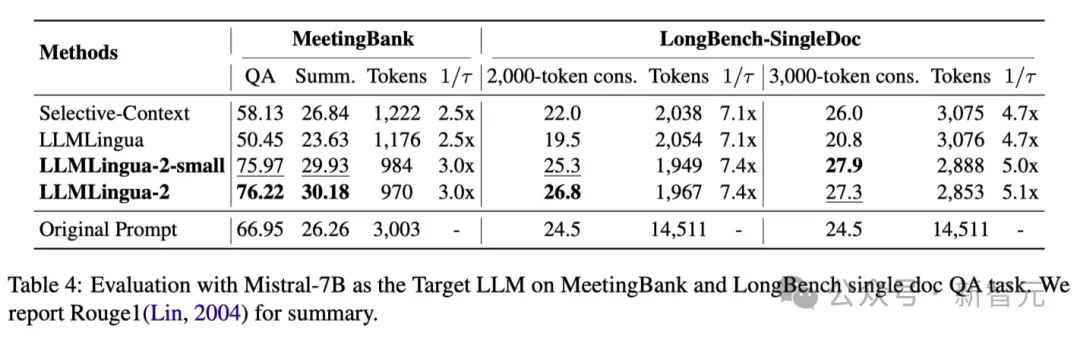

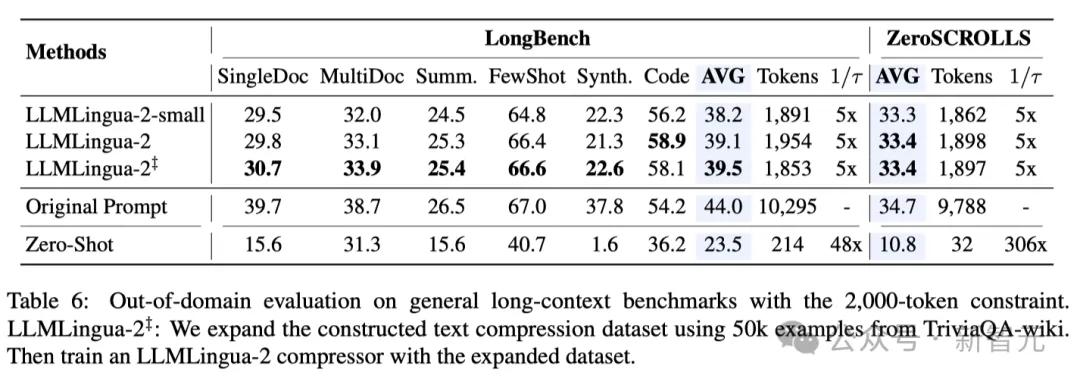

团队在包括MeetingBank、LongBench、ZeroScrolls、GSM8K和BBH在内的多个数据集上测试了LLMLingua-2模型。

尽管这个模 型体积不大,但它在基准测试中取得了显著的性能提升,并且证明了其在不同的大语言模型(从GPT-3.5到Mistral-7B)和语种(从英语到中文)上具有出色的泛化能力。

型体积不大,但它在基准测试中取得了显著的性能提升,并且证明了其在不同的大语言模型(从GPT-3.5到Mistral-7B)和语种(从英语到中文)上具有出色的泛化能力。

系统提示:

作为一名杰出的语言学家,你擅长将较长的文段压缩成简短的表达方式,方法是去除那些不重要的词汇,同时尽可能多地保留信息。

用户提示:

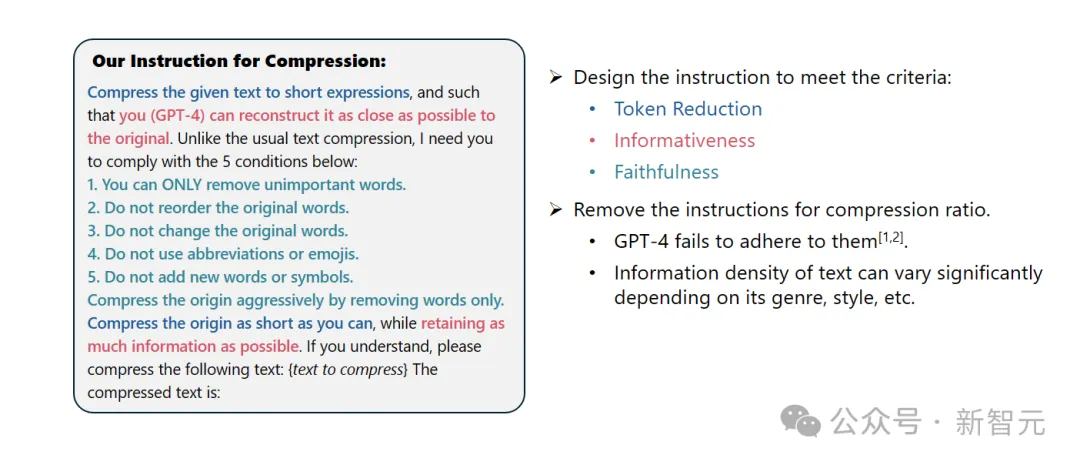

请将给定的文本压缩成简短的表达形式,使得你(GPT-4)能够尽可能准确地还原原文。不同于常规的文本压缩,我需要你遵循以下五个条件:

1. 只移除那些不重要的词汇。

2. 保持原始词汇的顺序不变。

3. 保持原始词汇不变。

Machine Translation

Machine Translation

聚合多个来源的AI翻译

49

查看详情

49

查看详情

4. 不使用任何缩写或表情符号。

5. 不添加任何新的词汇或符号。

请尽可能地压缩原文,同时保留尽可能多的信息。如果你明白了,请对以下文本进行压缩:{待压缩文本}

压缩后的文本是:[...]

结果显示,在问答、摘要撰写和逻辑推理等多种语言任务中,LLMLingua-2都显著优于原有的LLMLingua模型和其他选择性上下文策略。

值得一提的是,这种压缩方法对于不同的大语言模型(从GPT-3.5到Mistral-7B)和不同的语言(从英语到中文)同样有效。

而且,只需两行代码,就可以实现LLMLingua-2的部署。

目前,该模型已经被集成到了广泛使用的RAG框架LangChain和LlamaIndex当中。

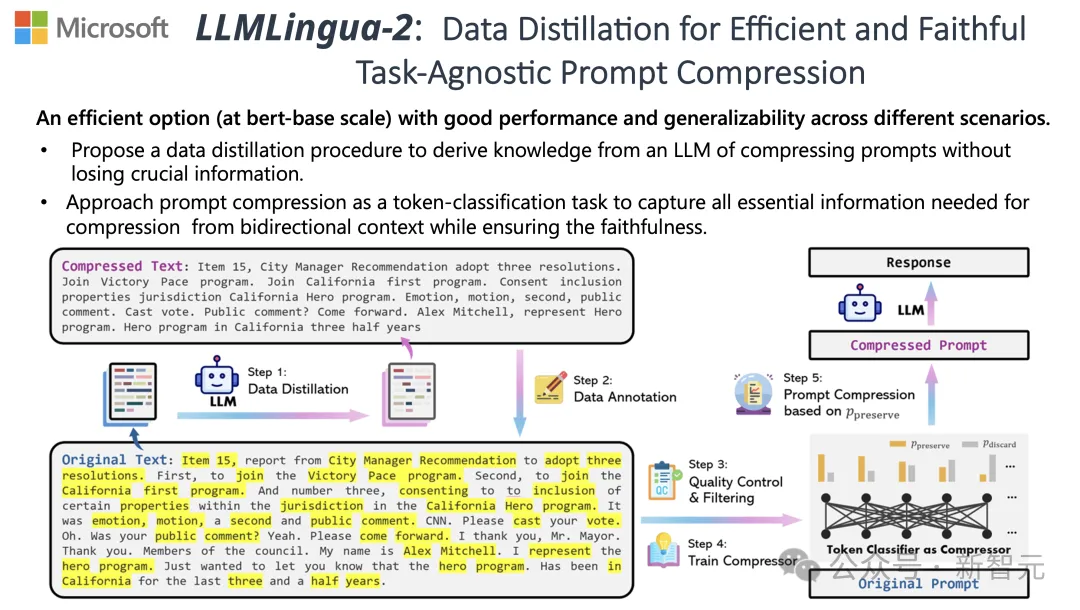

为了克服现有基于信息熵的文本压缩方法所面临的问题,LLMLingua-2采取了一种创新的数据提炼策略。

这一策略通过从GPT-4这样的大语言模型中抽取精华信息,实现了在不损失关键内容和避免添加错误信息的前提下,对文本进行高效压缩。

提示设计

要想充分利用GPT-4的文本压缩潜力,关键在于如何设定精确的压缩指令。

也就是在压缩文本时,指导GPT-4仅移除那些在原始文本中不那么重要的词汇,同时避免在此过程中引入任何新的词汇。

这样做的目的是为了确保压缩后的文本尽可能地保持原文的真实性和完整性。

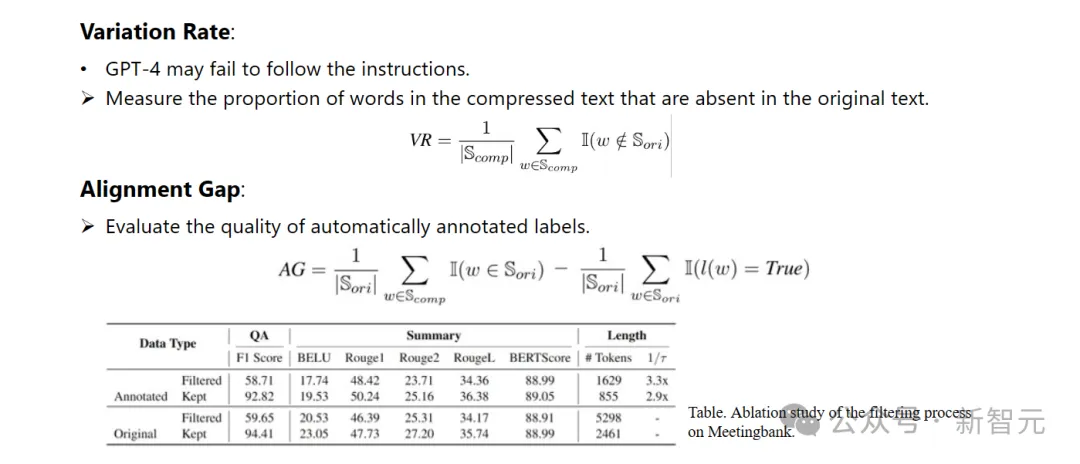

标注与筛选

研究人员利用了从GPT-4等大语言模型中提炼出的知识,开发了一种新颖的数据标注算法。

这个算法能够对原文中的每一个词汇进行标注,明确指出在压缩过程中哪些词汇是必须保留的。

为了保证所构建数据集的高质量,他们还设计了两种质量监控机制,专门用来识别并排除那些品质不佳的数据样本。

压缩器

最后,研究人员将文本压缩的问题转化为了一个对每个词汇(Token)进行分类的任务,并采用了强大的Transformer作为特征提取器。

这个工具能够理解文本的前后关系,从而精确地抓取对于文本压缩至关重要的信息。

通过在精心构建的数据集上进行训练,研究人员的模型能够根据每个词汇的重要性,计算出一个概率值来决定这个词汇是应该被保留在最终的压缩文本中,还是应该被舍弃。

研究人员在一系列任务上测试了LLMLingua-2的性能,这些任务包括上下文学习、文本摘要、对话生成、多文档和单文档问答、代码生成以及合成任务,既包括了域内的数据集也包括了域外的数据集。

测试结果显示,研究人员的方法在保持高性能的同时,减少了最小的性能损失,并且在任务不特定的文本压缩方法中表现突出。

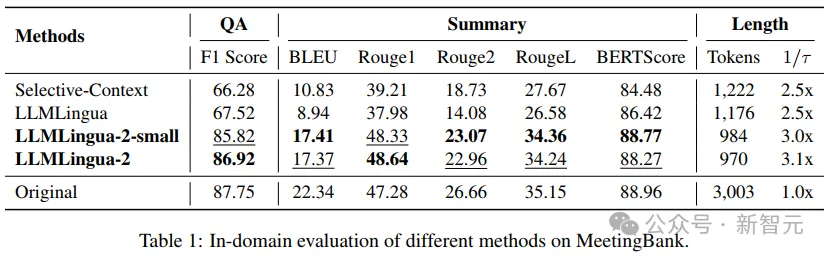

- 域内测试(MeetingBank)

研究人员将LLMLingua-2在MeetingBank测试集上的表现与其他强大的基线方法进行了对比。

尽管他们的模型规模远小于基线中使用的LLaMa-2-7B,但在问答和文本摘要任务上,研究人员的方法不仅大幅提升了性能,而且与原始文本提示的表现相差无几。

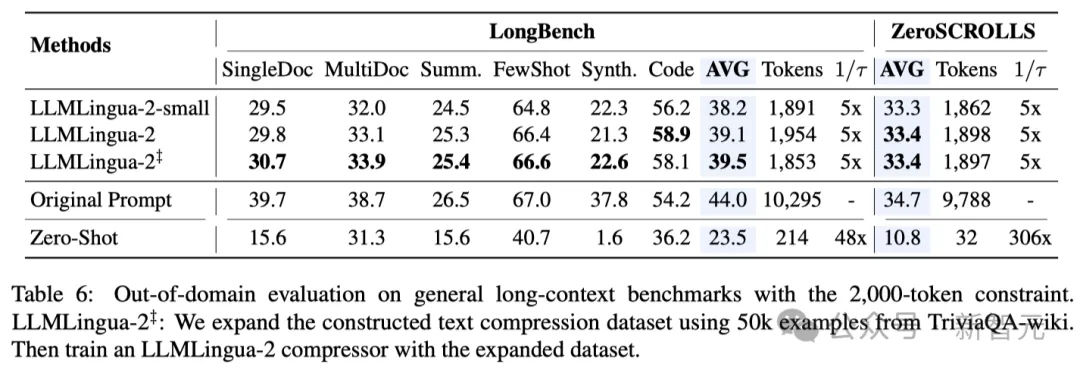

- 域外测试(LongBench、GSM8K和BBH)

考虑到研究人员的模型仅在MeetingBank的会议记录数据上进行了训练,研究人员进一步探索了其在长文本、逻辑推理和上下文学习等不同场景下的泛化能力。

值得一提的是,尽管LLMLingua-2只在一个数据集上训练,但在域外的测试中,它的表现不仅与当前最先进的任务不特定压缩方法相媲美,甚至在某些情况下还有过之而无不及。

即使是研究人员的较小模型(BERT-base大小),也能达到与原始提示相当的性能,在某些情况下甚至略高于原始提示。

虽然研究人员的方法取得了可喜的成果,但与其他任务感知压缩方法(如Longbench上的LongLLMlingua)相比,研究人员的方法还存在不足。

研究人员将这种性能差距归因于它们从问题中获取的额外信息。不过,研究人员的模型具有与任务无关的特点,因此在不同场景中部署时,它是一种具有良好通用性的高效选择。

上表4列出了使用Mistral-7Bv0.1 4作为目标LLM的不同方法的结果。

与其他基线方法相比,研究人员的方法在性能上有明显的提升,展示了其在目标LLM上良好的泛化能力。

值得注意的是,LLMLingua-2的性能甚至优于原始提示。

研究人员推测,Mistral-7B在管理长上下文方面的能力可能不如GPT-3.5-Turbo。

研究人员的方法通过提供信息密度更高的短提示,有效提高了 Mistral7B 的最终推理性能。

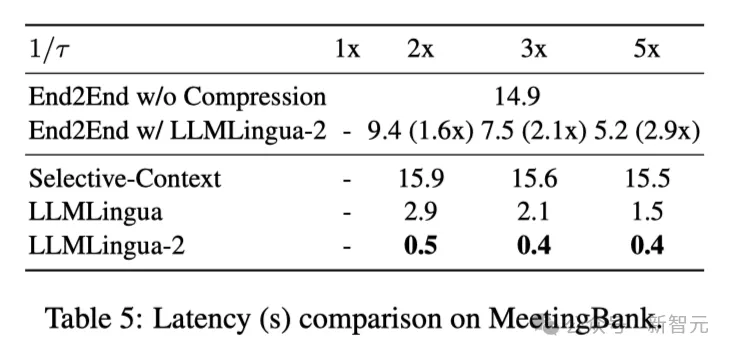

上表5显示了不同系统在不同压缩比的V100-32G GPU上的延迟。

结果表明,与其他压缩方法相比,LLMLingua2的计算开销要小得多,可以实现1.6倍到2.9倍的端到端速度提升。

此外,研究人员的方法还能将GPU内存成本降低8倍,从而降低对硬件资源的需求。

上下文意识观察 研究人员观察到,随着压缩率的增加,LLMLingua-2可以有效地保持与完整上下文相关的信息量最大的单词。

这要归功于双向上下文感知特征提取器的采用,以及明确朝着及时压缩目标进行优化的策略。

研究人员观察到,随着压缩率的增加,LLMLingua-2可以有效地保持与完整上下文相关的信息量最大的单词。

这要归功于双向上下文感知特征提取器的采用,以及明确朝着及时压缩目标进行优化的策略。

最后研究人员让GPT-4 从 LLMLingua-2压缩提示中重构原始提示音。

结果表明,GPT-4可以有效地重建原始提示,这表明在LLMLingua-2压缩过程中并没有丢失基本信息。

以上就是清华微软开源全新提示词压缩工具,长度骤降80%!GitHub怒砍3.1K星的详细内容,更多请关注其它相关文章!

# 域外

# 社交网站推广怎么做

# seo优化师留痕

# 廊坊官方关键词排名价格

# 同安区百度营销推广

# 阿克苏企业seo

# 北京网页优化seo费用

# 电视剧网站怎么做推广

# 拉萨高效网站建设公司

# 建设好的网站如何运营

# 旅游公司网站建设流程

# 过程中

# 微软

# 有效地

# 的是

# 官网

# 压缩工具

# 开源

# 清华

# 关键词

# llama

# langchain

# 研究

相关栏目:

【

Google疑问12 】

【

Facebook疑问10 】

【

优化推广96088 】

【

技术知识133117 】

【

IDC资讯59369 】

【

网络运营7196 】

【

IT资讯61894 】

相关推荐:

英伟达H100霸榜权威AI性能测试 11分钟搞定基于GPT-3的大模型训练

三星加速AR眼镜进程,预计明年上半年亮相

MiracleVision视觉大模型上线时间

石头扫拖机器人 G20 618 福利来袭:4999 元,超值配件领到手软

到中国科技馆体验“一滴油的奇妙旅行”,线上元宇宙展厅同步开启

AI数字人业务频频获点赞,谦寻积极引领示范作用

国内阅读行业首款对话式AI应用“阅爱聊”封闭内测

Hugging Face发布了基于NASA卫星数据构建的AI地理空间基础模型

消息称 Meta Quest 将推 VR 游戏订阅:每月 7.99 美元,任选两款

GPT-4不能在麻省理工学院获得计算机科学学位

AI工具助力公司实施每周4.5天工作制,带来巨大效益

埃森哲俞毅:AI时代我们需要新的“摩尔定律”

云南首例达芬奇机器人微创心脏手术成功开展

2025世界人工智能大会成功召开

《流浪地球2》里机器人公司的创始人:未来10年,机器人的崛起!

Unity发布Sentis和Muse AI工具,助力创作游戏和3D内容

卫星通信牵引物联网竞争升维,模组厂商如何决胜百亿市场?

鹅厂机器狗抢起真狗「饭碗」!会撒欢儿做游戏,遛人也贼6

1.6亿美元收购Singularity AI,昆仑万维布局通用人工智能

选对AI智能写作软件,让创作游刃有余!

广州团建公司方案 | 绝密飞行 → X-PLANE无人机团建主题团建

当一切设备都受到人工智能的控制

美图设计室2.0什么时候上线

《爱康未来之夜嘉宾官宣,携手共赴AI未来》

原小米 9 号员工李明打造全球首款 AI 安卓桌面机器人

特斯拉 Optimus 人形机器人入驻北美门店,帮助提升汽车销量

揭晓2025年玻尔兹曼奖:Hopfield网络创始人荣获奖项

普林斯顿Infinigen矩阵开启!AI造物主100%创造大自然,逼真到炸裂

J*a与人工智能结合:构建智能云服务

社区里,孩子们体验“机器人竞技”

Zoom远程会议应用:AI培训需经用户授权

人工智能自己玩自己

眼球反射解锁3D世界,黑镜成真!马里兰华人新作炸翻科幻迷

严打“黑飞”,无人机检测反制设备护航大运会净空安全

首家承认ChatGPT影响其收入的公司Chegg选择拥抱AI ,裁减4%员工

陈根:AI冥想教练为用户提供个性化指导

周星驰支持的人工智能与 Web3 初创公司 Moonbox 完成 100 万美元融资

IBM和NASA合作发布可追踪碳排放的开源AI基础模型

苹果在韩举办首届中小企业智能制造论坛,加速推动工业4.0发展

构建AI绘画网站的方法:使用API接口和调用步骤

腾讯机器狗进化:通过深度学习掌握自主决策能力

MetaGPT AI 模型开源:可模拟软件公司开发过程,生成高质量代码

AMD称下半年AI显卡供应充足,不需要像NVIDIA那样加价抢购

马斯克WAIC2025演讲全文:AI将对人类文明产生深远影响

微软大牛加入ZOOM,AI人才大战打响

创新科学家成功研发FAST激光靶标维护机器人

华为4G5G通信物联网收费标准公布,多年研发成果,十年花费近万亿

首届亚太网络法实务大会召开 九位大咖探讨元宇宙与人工智能发展

生成式人工智能如何改变云安全的游戏规则

新闻传闻:迪士尼可能采用人工智能来控制电影制作成本

2024-03-26

运城市盐湖区信雨科技有限公司是一家深耕海外推广领域十年的专业服务商,作为谷歌推广与Facebook广告全球合作伙伴,聚焦外贸企业出海痛点,以数字化营销为核心,提供一站式海外营销解决方案。公司凭借十年行业沉淀与平台官方资源加持,打破传统外贸获客壁垒,助力企业高效开拓全球市场,成为中小企业出海的可靠合作伙伴。